« Grand modèle de langues multimodal » : différence entre les versions

Aucun résumé des modifications |

m (Remplacement de texte : « ==Español== » par « ==Español== Catégorie:es ») |

||

| (Une version intermédiaire par un autre utilisateur non affichée) | |||

| Ligne 22 : | Ligne 22 : | ||

==Español== | ==Español== | ||

[[Catégorie:es]] | |||

''''' modelo extenso de lenguaje multimodal ''''' | ''''' modelo extenso de lenguaje multimodal ''''' | ||

| Ligne 28 : | Ligne 29 : | ||

''Modelos fundacionales como BERT, GPT-3, LLaMA y DALL-E pueden adaptarse a una amplia gama de tareas.'' | ''Modelos fundacionales como BERT, GPT-3, LLaMA y DALL-E pueden adaptarse a una amplia gama de tareas.'' | ||

==Sources== | ==Sources== | ||

Dernière version du 23 septembre 2025 à 20:57

Définition

Grand modèle de langues qui admet plusieurs modalités de représentation de l'information des données (texte, son, image, vidéo, données issues de capteurs, etc.) en entrée et en sortie.

Voir aussi modèle multimodal

Français

grand modèle de langues multimodal

grand modèle de langage multimodal

GMLM

grand modèle multimodal

Anglais

multimodal large language model

MLLM

large multimodal model

Basically, multimodal LLMs combine text with other kinds of information, such as images, videos, audio, and other sensory data. Multimodality can solve some of the problems of the current generation of LLMs. Multimodal language models will also unlock new applications that were impossible with text-only models.

Español

modelo extenso de lenguaje multimodal

Investigadores de la Universidad de Stanford han propuesto el término modelo fundacional (del inglès foundation model) para definir un conjunto de modelo extenso de lenguaje basados en arquitecturas de transformadores preentrenadas en grandes corpus, a veces utilizando varias modalidades (texto, voz, imágenes, etc.).

Modelos fundacionales como BERT, GPT-3, LLaMA y DALL-E pueden adaptarse a una amplia gama de tareas.

Sources

Source: Developpez.com

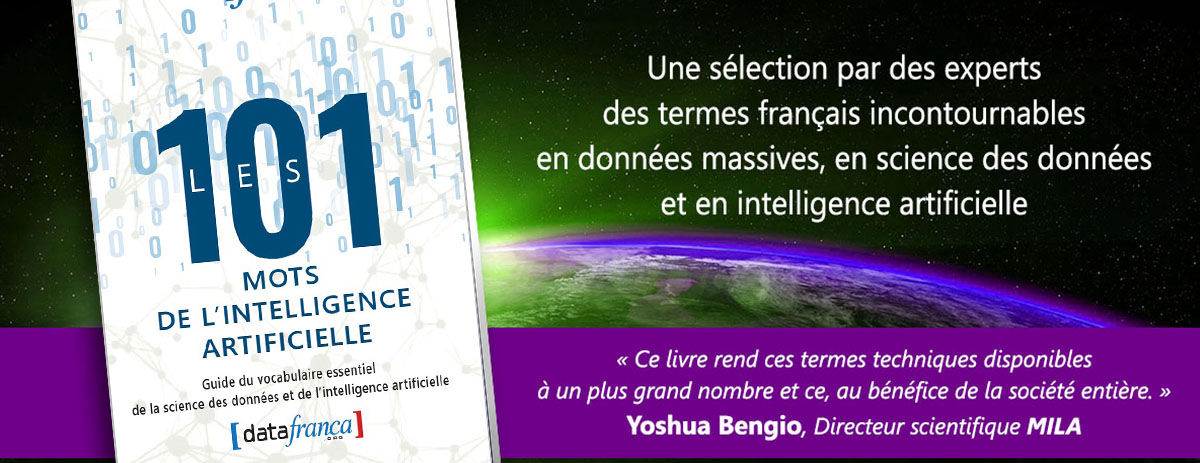

101 MOTS DE L' IA

Ce terme est sélectionné pour le livre « Les 101 mots de l'intelligence artificielle »

![]()

Contributeurs: Claude Coulombe, Espanol: JSZ, Patrick Drouin, wiki